El CEO de OpenAI, Sam Altman, participó en un evento organizado por The Indian Express. Durante la entrevista realizó algunas declaraciones llamativas, pero la mayor de todas ellas fue la que dedicó a hablar de lo que cuesta entrenar a un modelo de IA. De hecho, se quejó de cómo muchos de los debates sobre el consumo energético de ChatGPT son injustos.

Entrenar humanos también consume muchísimo. El entrevistador le preguntaba a Altman por el consumo de energía de ChatGPT y Sam Altman se tomaba unos segundos para responder sobre dicha cuestión, y luego realizaba una comparación peculiar (negritas mías):

Una de las cosas que siempre es injusta en esta comparación es que se habla de cuánta energía se necesita para entrenar un modelo de IA en comparación con lo que le cuesta a un humano realizar una consulta de inferencia.

Pero también se necesita mucha energía para entrenar a un humano. Se necesitan unos 20 años de vida y toda la comida que comes durante ese tiempo antes de volverte inteligente. Y no solo eso, se necesitó la evolución generalizada de los cien mil millones de personas que han vivido y aprendido a no ser devoradas por depredadores y a comprender la ciencia y demás para crearte.

La comparación justa es si le preguntas a ChatGPT, ¿cuánta energía se necesita una vez que su modelo está entrenado para responder esa pregunta en comparación con un humano? Y probablemente la IA ya se ha puesto al día en términos de eficiencia energética si lo medimos así.

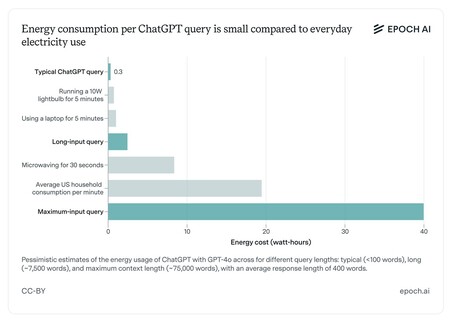

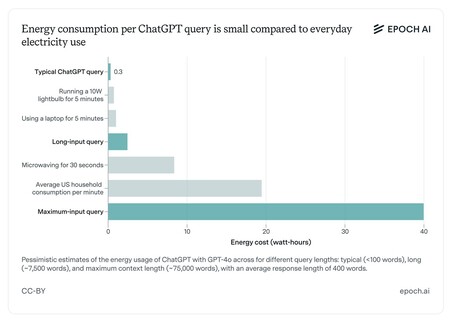

Un estudio previo de Epoch AI corrobora que el consumo energético durante la inferencia (cuando realmente usamos ChatGPT, por ejemplo) es reducido. Fuente: Epoch AI.

Un estudio previo de Epoch AI corrobora que el consumo energético durante la inferencia (cuando realmente usamos ChatGPT, por ejemplo) es reducido. Fuente: Epoch AI.Una cosa es el entrenamiento, y otra la inferencia. La respuesta puede resultar polémica, pero hasta cierto punto tiene lógica: el aprendizaje, tanto en el caso de los seres humanos como en el de la IA, lleva tiempo y consume muchos recursos, pero una cosa es ese coste y otra distinta el coste de la inferencia, de "aplicar ese entrenamiento". Una vez hemos aprendido, no cuesta demasiado contestar a cosas. Es lo que trata aquí de apuntar Altman, que reconoce que efectivamente la IA consume mucha energía en el entrenamiento, pero que luego ya se ha vuelto muy eficiente en la fase de inferencia, cuando realmente usamos ChatGPT. El problema es que aunque Altman ya ha hablado de que en la inferencia el consumo es mínimo, no da pruebas de ello.

El problema del agua ya no es un problema. También habló del polémico consumo de agua que teóricamente se hacía en los grandes centros de datos de IA. Aunque reconoció que aquello era un problema cuando "solíamos hacer uso de refrigeración evaporativa en los centros de datos". Ahora, sin embargo, "no hacemos eso", recordó, y dejó claro que esas acusaciones de que "ChatGPT usa 17 galones por cada consulta, o los que sean" es totalmente falsa, "totalmente loca, no tiene conexión alguna con la realidad". Pero de nuevo, sigue sin haber datos oficiales de las empresas de IA en este apartado.

¿Cuánto consume realmente la IA? Lo cierto es que a estas alturas seguimos sin tener datos realmente claros de cuánto consume la IA tanto en la fase de entrenamiento como en la fase de inferencia. Hay quien ha investigado el consumo de energía y agua y ha metido la pata exagerando los datos de forma estrepitosa, pero por ejemplo en EEUU, donde se concentran un gran números de centros de datos, no hay una legislación que obligue a la transparencia con esas cifras.

Modelos y centros de datos cada vez más eficientes. Uno de los estudios más interesantes fue el que realizó Epoch AI en febrero de 2025, y en aquel momento también se llegó a la conclusión de que en realidad la IA no consumía tanto como se decía que consumía. De hecho, consumía relativamente poco y los modelos no han hecho más que mejorar en eficiencia. También los chips y los sistemas de refrigeración han mejorado, y aunque ciertamente los centros de datos requieren cantidades ingentes de energía, seguimos a ciegas en este apartado.

En Xataka | España tiene un plan para captar más centros de datos que nadie: "blindarles" ante los costes de la energía

via Robótica e IA - Xataka https://ift.tt/jODfhKL

No hay comentarios:

Publicar un comentario