Y, de repente, Astro. Hace apenas un par de días Amazon sorprendía con el anuncio de su primer robot; un dispositivo que cuenta con una pantalla con dos cámaras y se desplaza gracias a sus ruedas. El dispositivo, que llegará a finales de este año, tiene como objetivo 'patrullar' la casa y avisar al propietario si hubiese algún problema. De acuerdo con la empresa, es capaz de reconocer toda la casa, distinguir entre animales, personas y objetos y detenerse antes de caer por una escalera. No obstante, información compartida recientemente por 'Motherboard' apunta que la máquina podría no estar tan pulida como la tecnológica quiso hacer ver durante la presentación. De acuerdo con fuentes que trabajaron en su diseño y documentos internos del desarrollo, a los que ha accedido el medio, Astro -conocido como 'Vesta' en nombre clave dentro de Amazon- registra muchos fallos. «Astro es terrible y es casi seguro que se tirará por un tramo de escaleras si se le presenta la oportunidad. La detección de personas no es confiable en el mejor de los casos, lo que hace que la propuesta de seguridad en el hogar sea ridícula», señala a este respecto una persona que trabajó en el proyecto. También se apunta que los materiales empleados por Amazon para la construcción de la máquina no son de la mejor calidad y que se rompen con facilidad: «El dispositivo resulta frágil para algo que tiene un coste absurdo. El mástil se ha roto en varios dispositivos, bloqueándose en la posición extendida o retraída, y no hay forma de enviarlo a Amazon cuando eso sucede». Otra fuente apunta que Astro «es un desastre que no está listo para su lanzamiento». Además, destaca que l os sistemas de reconomiento del dispositivo, que permite que pueda reconocer a las personas que habitan en la casa, funcionan mal. Algo que, como explican desde 'Motherboard', es preocupante en un dispositivo que, precisamente, está diseñado para seguir a las personas y determinar si son extraños o no. Fuentes de Amazon, que se han puesto en contacto con el medio, apuntan que la información vertida por las fuentes sobre el dispositivo, que tiene un precio de 999 euros, es «inexacta»: «Astro pasó por pruebas rigurosas tanto de calidad como de seguridad, incluidas decenas de miles de horas de pruebas con participantes beta. Esto incluye pruebas exhaustivas del sistema de seguridad avanzado de Astro, que está diseñado para evitar objetos, detectar escaleras y detener el dispositivo donde y cuando sea necesario».

Y, de repente, Astro. Hace apenas un par de días Amazon sorprendía con el anuncio de su primer robot; un dispositivo que cuenta con una pantalla con dos cámaras y se desplaza gracias a sus ruedas. El dispositivo, que llegará a finales de este año, tiene como objetivo 'patrullar' la casa y avisar al propietario si hubiese algún problema. De acuerdo con la empresa, es capaz de reconocer toda la casa, distinguir entre animales, personas y objetos y detenerse antes de caer por una escalera. No obstante, información compartida recientemente por 'Motherboard' apunta que la máquina podría no estar tan pulida como la tecnológica quiso hacer ver durante la presentación. De acuerdo con fuentes que trabajaron en su diseño y documentos internos del desarrollo, a los que ha accedido el medio, Astro -conocido como 'Vesta' en nombre clave dentro de Amazon- registra muchos fallos. «Astro es terrible y es casi seguro que se tirará por un tramo de escaleras si se le presenta la oportunidad. La detección de personas no es confiable en el mejor de los casos, lo que hace que la propuesta de seguridad en el hogar sea ridícula», señala a este respecto una persona que trabajó en el proyecto. También se apunta que los materiales empleados por Amazon para la construcción de la máquina no son de la mejor calidad y que se rompen con facilidad: «El dispositivo resulta frágil para algo que tiene un coste absurdo. El mástil se ha roto en varios dispositivos, bloqueándose en la posición extendida o retraída, y no hay forma de enviarlo a Amazon cuando eso sucede». Otra fuente apunta que Astro «es un desastre que no está listo para su lanzamiento». Además, destaca que l os sistemas de reconomiento del dispositivo, que permite que pueda reconocer a las personas que habitan en la casa, funcionan mal. Algo que, como explican desde 'Motherboard', es preocupante en un dispositivo que, precisamente, está diseñado para seguir a las personas y determinar si son extraños o no. Fuentes de Amazon, que se han puesto en contacto con el medio, apuntan que la información vertida por las fuentes sobre el dispositivo, que tiene un precio de 999 euros, es «inexacta»: «Astro pasó por pruebas rigurosas tanto de calidad como de seguridad, incluidas decenas de miles de horas de pruebas con participantes beta. Esto incluye pruebas exhaustivas del sistema de seguridad avanzado de Astro, que está diseñado para evitar objetos, detectar escaleras y detener el dispositivo donde y cuando sea necesario».via Tecnología https://ift.tt/3kUpUpJ

Amazon acaba de presentar sus novedades. Nuevos dispositivos se añaden a la ya amplia colección de la firma. Y algunos han sido toda una sorpresa. El primero es un termostato inteligente que nos ayuda a controlar el consumo. Sencillo de instalar, solo cuesta 59 dólares y se controla con la voz a través de Alexa. Se puede programar. Más interesante fue el nuevo miembro de la familia Echo. Se trata del Echo Show 15, con una gran pantalla de 15,6 pulgadas, mucho mayor que la clásica tele que tenemos en la cocina, y que puede incluso colgarse de la pared. No es un televisor, pero casi. La interface es nueva y muestra la información relevante del día. Cada miembro de la familia puede añadir sus propias citas al calendario o dejar notas para los demás en la propia pantalla. El nuevo Echo Show 15 es algo parecido a una pizarra desde la que se pueden controlar todos los dispositivos inteligentes de la casa, desde encender luces a ver otras habitaciones con las cámaras. Por supuesto, también se pueden consumir todo tipo de contenidos multimedia, desde noticias a series o películas de Prime Video o Netflix. Si no hacemos nada, podemos pedirle que haga rotar imágenes, a modo de salvapantallas. El diuspositivo incorpora hasta siete nuevas tecnologías. La principal viene de la mano de un nuevo procesador inteligente, el AZ2, que, con sus cuatro núcleos, sustituye al AZ1 del año pasado. Otra novedad son una serie de sonidos personalizados que pueden avisarnos, por ejemplo si hemos dejado abierta la puerta de la nevera. El nuevo Echo Show 15 estará disponible a finales de año por un precio recomendado de 249,99 dólares. Amazon Glow, ¿solo para niños? Gracias a una colaboración especial con Disney, los más pequeños podrán interactuar con los personajes, los juegos y los contenidos de la popular firma con solo decir 'Hey Disney' a su dispositivo Alexa. Solo hay que activar la nueva experiencia para poder disfrutar de ella en los altavoces Echo. Para los más pequeños, aunque no solo para ellos, nace el nuevo Amazon Glow, un curioso dispositivo que nos permite conectar con un solo toque con los miembros de nuestra familia que elijamos, hijos, abuelos o nietos. El dispositivo va mucho más allá de las videoconferencias, y permite interactuar a las personas que están a ambos lados de la comunicación proyectando sobre una mesa, o en el suelo, una pantalla virtual que se puede manipular desde los dos extremos de la conexión. Así, por ejemplo, los niños podrán jugar en cualquier momento con sus abuelos lejanos, hacer puzzles con ellos o ver juntos una serie de dibujos animados. El precio será de 249,99 dólares. Astro, el primer robot doméstico de Amazon Pero sin duda lo más espectacular fue la presentación de Astro, el primer robot de Amazon. Su cara es una pantalla, sus ojos dos cámaras y se desplaza sobre ruedas. No mide más de 50 cm de alto, pero puede ir por toda la casa. Puede hacer todo lo que hacen los demàs dispositivos Alexa, monitorizar la casa, patrullarla, comprobar que todo está en orden y, si no lo está, avisar al dueño con un mensaje o con un vídeo del problema. Puede llegar a ver los lugares altos proyectando una antena telescópica sobre su cabeza, equipada con una cámara, de modo que no habrá nada que se le escape. Si capta actividad mientras no estamos, investigará. Si escucha algún ruido sospechoso, irá a ver qué pasa. Hará un mapa de la casa y lo aprenderá de memoria. No solo es una cámara con ruedas. Detecta y comprende todo tipo de situaciones, distingue una mascota de una silla y sabe dónde están las puertas. Si encuentra una escalera, se detendrá. Costará 999 dólares a partir de fin de año. Se actualizará, haciendose cada vez mñas inteligente, durante siete años. Salud y seguridad Dentro de la familia Halo, destinada a mejorar la salud y la forma física, Amazon presentó también su nueva pulsera de actividd Halo View, con una pantalla AMOLED y desde la que se puede acceder a todas las métricas de Halo para monitorizar nuestra actividad física, pero también controlar lo que comemos. En seguridad, la gama Ring, que consta de sensores, alarmas y cámaras, también crece. El año pasado Amazon presentó una única cámara para toda la casa. Un pequeño dron que volaba por todas las habitaciones y nos evitaba tener múltiples.dispositivos. Un nuevo Kit Ring Alarm Pro consta de cinco dispositivos de seguridad que trabajan juntos. Cuentan 249,99 dólares.

Amazon acaba de presentar sus novedades. Nuevos dispositivos se añaden a la ya amplia colección de la firma. Y algunos han sido toda una sorpresa. El primero es un termostato inteligente que nos ayuda a controlar el consumo. Sencillo de instalar, solo cuesta 59 dólares y se controla con la voz a través de Alexa. Se puede programar. Más interesante fue el nuevo miembro de la familia Echo. Se trata del Echo Show 15, con una gran pantalla de 15,6 pulgadas, mucho mayor que la clásica tele que tenemos en la cocina, y que puede incluso colgarse de la pared. No es un televisor, pero casi. La interface es nueva y muestra la información relevante del día. Cada miembro de la familia puede añadir sus propias citas al calendario o dejar notas para los demás en la propia pantalla. El nuevo Echo Show 15 es algo parecido a una pizarra desde la que se pueden controlar todos los dispositivos inteligentes de la casa, desde encender luces a ver otras habitaciones con las cámaras. Por supuesto, también se pueden consumir todo tipo de contenidos multimedia, desde noticias a series o películas de Prime Video o Netflix. Si no hacemos nada, podemos pedirle que haga rotar imágenes, a modo de salvapantallas. El diuspositivo incorpora hasta siete nuevas tecnologías. La principal viene de la mano de un nuevo procesador inteligente, el AZ2, que, con sus cuatro núcleos, sustituye al AZ1 del año pasado. Otra novedad son una serie de sonidos personalizados que pueden avisarnos, por ejemplo si hemos dejado abierta la puerta de la nevera. El nuevo Echo Show 15 estará disponible a finales de año por un precio recomendado de 249,99 dólares. Amazon Glow, ¿solo para niños? Gracias a una colaboración especial con Disney, los más pequeños podrán interactuar con los personajes, los juegos y los contenidos de la popular firma con solo decir 'Hey Disney' a su dispositivo Alexa. Solo hay que activar la nueva experiencia para poder disfrutar de ella en los altavoces Echo. Para los más pequeños, aunque no solo para ellos, nace el nuevo Amazon Glow, un curioso dispositivo que nos permite conectar con un solo toque con los miembros de nuestra familia que elijamos, hijos, abuelos o nietos. El dispositivo va mucho más allá de las videoconferencias, y permite interactuar a las personas que están a ambos lados de la comunicación proyectando sobre una mesa, o en el suelo, una pantalla virtual que se puede manipular desde los dos extremos de la conexión. Así, por ejemplo, los niños podrán jugar en cualquier momento con sus abuelos lejanos, hacer puzzles con ellos o ver juntos una serie de dibujos animados. El precio será de 249,99 dólares. Astro, el primer robot doméstico de Amazon Pero sin duda lo más espectacular fue la presentación de Astro, el primer robot de Amazon. Su cara es una pantalla, sus ojos dos cámaras y se desplaza sobre ruedas. No mide más de 50 cm de alto, pero puede ir por toda la casa. Puede hacer todo lo que hacen los demàs dispositivos Alexa, monitorizar la casa, patrullarla, comprobar que todo está en orden y, si no lo está, avisar al dueño con un mensaje o con un vídeo del problema. Puede llegar a ver los lugares altos proyectando una antena telescópica sobre su cabeza, equipada con una cámara, de modo que no habrá nada que se le escape. Si capta actividad mientras no estamos, investigará. Si escucha algún ruido sospechoso, irá a ver qué pasa. Hará un mapa de la casa y lo aprenderá de memoria. No solo es una cámara con ruedas. Detecta y comprende todo tipo de situaciones, distingue una mascota de una silla y sabe dónde están las puertas. Si encuentra una escalera, se detendrá. Costará 999 dólares a partir de fin de año. Se actualizará, haciendose cada vez mñas inteligente, durante siete años. Salud y seguridad Dentro de la familia Halo, destinada a mejorar la salud y la forma física, Amazon presentó también su nueva pulsera de actividd Halo View, con una pantalla AMOLED y desde la que se puede acceder a todas las métricas de Halo para monitorizar nuestra actividad física, pero también controlar lo que comemos. En seguridad, la gama Ring, que consta de sensores, alarmas y cámaras, también crece. El año pasado Amazon presentó una única cámara para toda la casa. Un pequeño dron que volaba por todas las habitaciones y nos evitaba tener múltiples.dispositivos. Un nuevo Kit Ring Alarm Pro consta de cinco dispositivos de seguridad que trabajan juntos. Cuentan 249,99 dólares.

La tecnología no solo facilita la vida. Su constante avance también está siendo aprovechado por ejércitos de todo el mundo. Y el de Estados Unidos, evidentemente, no es una excepción. El país sigue preparándose para la guerra del futuro y para ser capaz de contrarrestar a cualquier estado antagonista en caso de conflicto. Recientemente su Departamento de Defensa ha compartido imágenes de uno de sus barcos robot experimentales, en concreto un USV Ranger que no necesita tripulación humana, lanzando por primera vez un misil. En concreto, uno de los más punteros del país, un SM-6 con una peso de 1.500 kilogramos, capacidad para viajar a Mach 3.5 y alcance superior a los 240 kilómetros. «Son una evolución de los SM-1 y las SM- 2 que tenían las fragatas españolas. Esto ya es un salto notable. Tienen capacidad para derribar misiles balísticos y, supuestamente, para interceptar misiles hipersónicos. Representan un salto tecnológico enorme», explica en conversación con ABC el analista de defensa Jesús Manuel Pérez Triana sobre el SM-6, que, además, puede ser empleado para atacar objetivos en tierra, mar y aire, independientemente de que estén en movimiento. En este caso, aunque el USV Ranger está capacitado para navegar sin necesidad de que haya nadie a bordo de la embarcación, la política estadounidense requiere que la selección del objetivo y el orden de disparo sean controlados por una persona, como recuerdan desde 'New Sciencist'. La prueba del lanzamiento, que ha sido compartida por el Departamento de Defensa a través de sus redes sociales, está encuadrada dentro del programa Ghost Fleet Overlord (Señor absoluto de la flota fantasma, en castellano). Está destinado al desarrollo de barcos autónomos. Hasta el momento, las pruebas dentro de esta iniciativa, que lleva activa desde 2017, se han centrado en probar la autonomía de los barcos robot en misiones sin asistencia humana; además, interesa que los dispositivos sean capaces de evitar a otras tripulaciones cuando estén en alta mar sin necesidad de que un humano les de órdenes. Desde 'New Sciencist' apuntan que esta no es la primera vez que un barco robot autónomo lanza un misil. El ejército israelí ya lo consiguió en 2007. Sin embargo, remarcan que el SM-6 estadounidense es 100 veces más grande que el proyectil empleado en esa prueba.<blockquote class="twitter-tweet"><p lang="en" dir="ltr">See the game-changing, cross-domain, cross-service concepts the Strategic Capabilities Office and <a href="https://twitter.com/USNavy?ref_src=twsrc%5Etfw">@USNavy</a> are rapidly developing: an SM-6 launched from a modular launcher off of USV Ranger. Such innovation drives the future of joint capabilities. <a href="https://twitter.com/hashtag/DoDInnovates?src=hash&ref_src=twsrc%5Etfw">#DoDInnovates</a> <a href="https://t.co/yCG57lFcNW">pic.twitter.com/yCG57lFcNW</a></p>— Department of Defense (@DeptofDefense) <a href="https://twitter.com/DeptofDefense/status/1433852377870839808?ref_src=twsrc%5Etfw">September 3, 2021</a></blockquote> <script async src="https://platform.twitter.com/widgets.js" charset="utf-8"></script> Compitiendo con China El interés en el desarrollo de armamento autónomo es una constante en países de todo el mundo desde hace aproximadamente una década. De acuerdo con Pérez Triana, detrás de la operación Ghost Fleet Overlord y del lanzamiento del misil se encuentra el interés de Estados Unidos por ser capaz de contrarrestar a China en caso de conflicto. Precisamente el país asiático lleva varios años fortaleciendo su armada. Hace apenas unos meses, su presidente, Xi Jinping, asitió a la inauguración de un nuevo submarino nuclear, un destructor y un buque de asalto. Las tensiones en el mar entre los dos países, además, llevan existiendo desde hace tiempo. El pasado 2020 China expulsó al destructor de misiles norteamericano USS Barry de las costas del Mar del Sur; territorio en disputa entre los dos estados. «(El desarrollo de barcos robot) te permite cubrir un área extensa del océano con unidades baratas y dirigidas de forma remota. Eso entra dentro del concepto de letalidad distribuida de la US Navy para enfrentarse a China», dice el analista de defensa. «Estados Unidos está diseñando una estrategia aeronaval para ser capaz de contrarrestar a China. Ha llegado a la conclusión de que la capacidad de detección del ejército chino provoca que los buques muy grandes y costosos, en un intercambio de misiles, llevarían las de perder. Eso se contrarresta con una flota muy numerosa, de buques cada vez más pequeños, e interconectados. De tal modo que si uno detecta a un enemigo este sea capaz de transmitir información al resto de unidades y esas, cada una en una esquina del tablero, serían capaces de lanzar su armamento inteligente contra la amenaza», completa Pérez Triana. Además, destaca que el área en el que se desarrollaría esa hipotética guerra marítima, el Pacífico que baña las costas de Asia, tiene una extensión enorme que obliga al desarrollo de «más buques y más pequeños». Estas embarcaciones, además, permiten que el coste en vidas en caso de sufrir un ataque llegue a ser inexistente, ya que pueden controlarse de forma autónoma. A pesar de ello, asociaciones, como 'Stop Killer Robots', y expertos en robótica e Inteligencia Artificial han alzado la voz en numerosas ocasiones para alertar sobre los riesgos de emplear armamento completamente autónomo y armado.

La tecnología no solo facilita la vida. Su constante avance también está siendo aprovechado por ejércitos de todo el mundo. Y el de Estados Unidos, evidentemente, no es una excepción. El país sigue preparándose para la guerra del futuro y para ser capaz de contrarrestar a cualquier estado antagonista en caso de conflicto. Recientemente su Departamento de Defensa ha compartido imágenes de uno de sus barcos robot experimentales, en concreto un USV Ranger que no necesita tripulación humana, lanzando por primera vez un misil. En concreto, uno de los más punteros del país, un SM-6 con una peso de 1.500 kilogramos, capacidad para viajar a Mach 3.5 y alcance superior a los 240 kilómetros. «Son una evolución de los SM-1 y las SM- 2 que tenían las fragatas españolas. Esto ya es un salto notable. Tienen capacidad para derribar misiles balísticos y, supuestamente, para interceptar misiles hipersónicos. Representan un salto tecnológico enorme», explica en conversación con ABC el analista de defensa Jesús Manuel Pérez Triana sobre el SM-6, que, además, puede ser empleado para atacar objetivos en tierra, mar y aire, independientemente de que estén en movimiento. En este caso, aunque el USV Ranger está capacitado para navegar sin necesidad de que haya nadie a bordo de la embarcación, la política estadounidense requiere que la selección del objetivo y el orden de disparo sean controlados por una persona, como recuerdan desde 'New Sciencist'. La prueba del lanzamiento, que ha sido compartida por el Departamento de Defensa a través de sus redes sociales, está encuadrada dentro del programa Ghost Fleet Overlord (Señor absoluto de la flota fantasma, en castellano). Está destinado al desarrollo de barcos autónomos. Hasta el momento, las pruebas dentro de esta iniciativa, que lleva activa desde 2017, se han centrado en probar la autonomía de los barcos robot en misiones sin asistencia humana; además, interesa que los dispositivos sean capaces de evitar a otras tripulaciones cuando estén en alta mar sin necesidad de que un humano les de órdenes. Desde 'New Sciencist' apuntan que esta no es la primera vez que un barco robot autónomo lanza un misil. El ejército israelí ya lo consiguió en 2007. Sin embargo, remarcan que el SM-6 estadounidense es 100 veces más grande que el proyectil empleado en esa prueba.<blockquote class="twitter-tweet"><p lang="en" dir="ltr">See the game-changing, cross-domain, cross-service concepts the Strategic Capabilities Office and <a href="https://twitter.com/USNavy?ref_src=twsrc%5Etfw">@USNavy</a> are rapidly developing: an SM-6 launched from a modular launcher off of USV Ranger. Such innovation drives the future of joint capabilities. <a href="https://twitter.com/hashtag/DoDInnovates?src=hash&ref_src=twsrc%5Etfw">#DoDInnovates</a> <a href="https://t.co/yCG57lFcNW">pic.twitter.com/yCG57lFcNW</a></p>— Department of Defense (@DeptofDefense) <a href="https://twitter.com/DeptofDefense/status/1433852377870839808?ref_src=twsrc%5Etfw">September 3, 2021</a></blockquote> <script async src="https://platform.twitter.com/widgets.js" charset="utf-8"></script> Compitiendo con China El interés en el desarrollo de armamento autónomo es una constante en países de todo el mundo desde hace aproximadamente una década. De acuerdo con Pérez Triana, detrás de la operación Ghost Fleet Overlord y del lanzamiento del misil se encuentra el interés de Estados Unidos por ser capaz de contrarrestar a China en caso de conflicto. Precisamente el país asiático lleva varios años fortaleciendo su armada. Hace apenas unos meses, su presidente, Xi Jinping, asitió a la inauguración de un nuevo submarino nuclear, un destructor y un buque de asalto. Las tensiones en el mar entre los dos países, además, llevan existiendo desde hace tiempo. El pasado 2020 China expulsó al destructor de misiles norteamericano USS Barry de las costas del Mar del Sur; territorio en disputa entre los dos estados. «(El desarrollo de barcos robot) te permite cubrir un área extensa del océano con unidades baratas y dirigidas de forma remota. Eso entra dentro del concepto de letalidad distribuida de la US Navy para enfrentarse a China», dice el analista de defensa. «Estados Unidos está diseñando una estrategia aeronaval para ser capaz de contrarrestar a China. Ha llegado a la conclusión de que la capacidad de detección del ejército chino provoca que los buques muy grandes y costosos, en un intercambio de misiles, llevarían las de perder. Eso se contrarresta con una flota muy numerosa, de buques cada vez más pequeños, e interconectados. De tal modo que si uno detecta a un enemigo este sea capaz de transmitir información al resto de unidades y esas, cada una en una esquina del tablero, serían capaces de lanzar su armamento inteligente contra la amenaza», completa Pérez Triana. Además, destaca que el área en el que se desarrollaría esa hipotética guerra marítima, el Pacífico que baña las costas de Asia, tiene una extensión enorme que obliga al desarrollo de «más buques y más pequeños». Estas embarcaciones, además, permiten que el coste en vidas en caso de sufrir un ataque llegue a ser inexistente, ya que pueden controlarse de forma autónoma. A pesar de ello, asociaciones, como 'Stop Killer Robots', y expertos en robótica e Inteligencia Artificial han alzado la voz en numerosas ocasiones para alertar sobre los riesgos de emplear armamento completamente autónomo y armado. Hemos llegado a un punto en el que el hardware de las aspiradoras, en autonomía, succión y capacidad de limpieza, es difícilmente mejorable. Lo que sí se puede perfeccionar es la inteligencia de la máquina para saber cuándo deben funcionar sin molestar y, sobre todo, mejorar su independencia, ya que la mejor aspiradora es la que necesita menos intervención humana. Precisamente, el fabricante de las aspiradoras Roomba, iRobot, tal y como anunció el año pasado, se ha centrado en mejorar la Inteligencia Artificial de sus dispositivos y por ello acaba de lanzar Genius 3.0, una actualización gratuita para todas sus aspiradoras con capacidades de conexión a internet. Esta nueva versión de Genius 3.0, tiene como objetivo que el hogar se vuelva realmente inteligente y que sea el robot el que trabaje para el hogar, no al revés. La nueva plataforma hace hincapié en tres aspectos, que el robot sea capaz de seguir las reglas de la casa, entender mejor el hogar y mejorar en el mapeado inteligente. Con la idea de molestar lo mínimo a los habitantes del domicilio, el sistema añade dos nuevas características. La primera es la incorporación del desplazamiento silencioso. Si, por ejemplo, quieres aspirar la cocina, pero alguien está echando la siesta, el robot puede llegar hasta ella sin molestar. En la segunda, la aplicación también detectará cuándo sales de casa por geolocalización en el teléfono móvil y aspirará te alejes. Parará, precisamente, cuando te vayas acercando a tu domicilio. En cuanto al mapeado para ayudar a la puesta en marcha inicial de cualquier Roomba, éste se podrá transferir entre robots, muy útil si estamos renovando aspiradora. También, este mapeado inicial se volverá más inteligente sugiriendo el etiquetado de estancias de forma automática. Otra novedad es que la aplicación ofrecerá una estimación del tiempo de limpieza para que podamos decidir si da tiempo a que limpie, por ejemplo, antes de una reunión. Lamentablemente, esta característica está sólo disponible para los robots con Imprint Smart Mapping, es decir la generación 7 y 9. El mejor representante de esta nueva actualización de Genius 3.0 es la nueva Roomba j7+. Por dentro, nos encontraremos unas capacidades muy similares a la i7. Donde mejora considerablemente es en su inteligencia, sobre todo, en aspectos clave como la detección de objetos. Por ejemplo, es capaz de esquivar objetos problemáticos, como unos auriculares, unos zapatos o cables que generalmente suelen acabar atascados en los cepillos del robot. Además, a través de la aplicación preguntará si los obstáculos son temporales o definitivos mostrando una foto de lo que haya encontrado. Así, si es una lámpara que hemos cambiado de sitio se lo podremos indicar. También, gracias a la inteligencia artificial puede detectar los 'accidentes' de las mascotas evitando dejalos esparcidos por la casa, como podría ocurrir con las generaciones anteriores de Roomba. Una característica interesante para los dueños de cachorros. Con esta visión mejorada de la Roomba j7+ la navegación se vuelve más delicada frenando antes de llegar a los muebles o las paredes, para que el toque con el frontal sea mucho más suave. La inteligencia del dispositivo está diseñada para anticiparse al desorden, para aprender de los momentos y lugares que más se ensucian, y sugerir horarios personalizados. Por ejemplo, empezar a limpiar cuando te vas de casa y parar en cuanto llegas para que nunca escuches el aspirador funcionando. También sugerirá limpiar con más frecuencia en épocas de alergias o si hay mascotas, en la muda de pelo. Siempre buscando la máxima de limpiar lo mejor posible, con la menor intervención. Toda esta inteligencia artificial tiene como objetivo hacer a su usuario la vida más fácil, hasta el punto de poder olvidarse de la aspiradora, pero también es más intrusiva en el hogar. iRobot es consciente de que mantener la privacidad es primordial, y por ello se pueden desactivar las imágenes tomadas por el dispositivo y que se envían a los servidores de iRobot, donde se usan para que la IA aprenda a detectar nuevos obstáculos. Desde la empresa apuntan que las imágenes que se envían a iRobot para que el algoritmo mejore siempre están cifradas. El diseño de la Roomba j7+ y su 'clean base' se ha mejorado buscando una mejor integración con el hogar con acabados más premium. El exterior del robot es de metal pulido, y la base se ha rediseñado para que quepa debajo de una mesa, siendo más baja, pero más ancha que sus predecesoras. Además, le han añadido detalles como un tirador de cuero para abrir la tapa y espacio para bolsas extra. Como en los sistemas anteriores, iRobot sigue confiando en la bolsa para almacenar la suciedad. De esa manera evita que el polvo se derrame al volcarlo en la basura, ya que la bolsa se cierra nada más sacarla de la base. La bolsa ofrece a la Roomba j7+ una autonomía de más de 60 días. Ahora, hay que tener en cuenta que el precio del dispositivo no está al alcance de todos los bolsillos. El j7+ alcanza los 999 euros, mientras que el j7, a secas, se queda en 749.

Hemos llegado a un punto en el que el hardware de las aspiradoras, en autonomía, succión y capacidad de limpieza, es difícilmente mejorable. Lo que sí se puede perfeccionar es la inteligencia de la máquina para saber cuándo deben funcionar sin molestar y, sobre todo, mejorar su independencia, ya que la mejor aspiradora es la que necesita menos intervención humana. Precisamente, el fabricante de las aspiradoras Roomba, iRobot, tal y como anunció el año pasado, se ha centrado en mejorar la Inteligencia Artificial de sus dispositivos y por ello acaba de lanzar Genius 3.0, una actualización gratuita para todas sus aspiradoras con capacidades de conexión a internet. Esta nueva versión de Genius 3.0, tiene como objetivo que el hogar se vuelva realmente inteligente y que sea el robot el que trabaje para el hogar, no al revés. La nueva plataforma hace hincapié en tres aspectos, que el robot sea capaz de seguir las reglas de la casa, entender mejor el hogar y mejorar en el mapeado inteligente. Con la idea de molestar lo mínimo a los habitantes del domicilio, el sistema añade dos nuevas características. La primera es la incorporación del desplazamiento silencioso. Si, por ejemplo, quieres aspirar la cocina, pero alguien está echando la siesta, el robot puede llegar hasta ella sin molestar. En la segunda, la aplicación también detectará cuándo sales de casa por geolocalización en el teléfono móvil y aspirará te alejes. Parará, precisamente, cuando te vayas acercando a tu domicilio. En cuanto al mapeado para ayudar a la puesta en marcha inicial de cualquier Roomba, éste se podrá transferir entre robots, muy útil si estamos renovando aspiradora. También, este mapeado inicial se volverá más inteligente sugiriendo el etiquetado de estancias de forma automática. Otra novedad es que la aplicación ofrecerá una estimación del tiempo de limpieza para que podamos decidir si da tiempo a que limpie, por ejemplo, antes de una reunión. Lamentablemente, esta característica está sólo disponible para los robots con Imprint Smart Mapping, es decir la generación 7 y 9. El mejor representante de esta nueva actualización de Genius 3.0 es la nueva Roomba j7+. Por dentro, nos encontraremos unas capacidades muy similares a la i7. Donde mejora considerablemente es en su inteligencia, sobre todo, en aspectos clave como la detección de objetos. Por ejemplo, es capaz de esquivar objetos problemáticos, como unos auriculares, unos zapatos o cables que generalmente suelen acabar atascados en los cepillos del robot. Además, a través de la aplicación preguntará si los obstáculos son temporales o definitivos mostrando una foto de lo que haya encontrado. Así, si es una lámpara que hemos cambiado de sitio se lo podremos indicar. También, gracias a la inteligencia artificial puede detectar los 'accidentes' de las mascotas evitando dejalos esparcidos por la casa, como podría ocurrir con las generaciones anteriores de Roomba. Una característica interesante para los dueños de cachorros. Con esta visión mejorada de la Roomba j7+ la navegación se vuelve más delicada frenando antes de llegar a los muebles o las paredes, para que el toque con el frontal sea mucho más suave. La inteligencia del dispositivo está diseñada para anticiparse al desorden, para aprender de los momentos y lugares que más se ensucian, y sugerir horarios personalizados. Por ejemplo, empezar a limpiar cuando te vas de casa y parar en cuanto llegas para que nunca escuches el aspirador funcionando. También sugerirá limpiar con más frecuencia en épocas de alergias o si hay mascotas, en la muda de pelo. Siempre buscando la máxima de limpiar lo mejor posible, con la menor intervención. Toda esta inteligencia artificial tiene como objetivo hacer a su usuario la vida más fácil, hasta el punto de poder olvidarse de la aspiradora, pero también es más intrusiva en el hogar. iRobot es consciente de que mantener la privacidad es primordial, y por ello se pueden desactivar las imágenes tomadas por el dispositivo y que se envían a los servidores de iRobot, donde se usan para que la IA aprenda a detectar nuevos obstáculos. Desde la empresa apuntan que las imágenes que se envían a iRobot para que el algoritmo mejore siempre están cifradas. El diseño de la Roomba j7+ y su 'clean base' se ha mejorado buscando una mejor integración con el hogar con acabados más premium. El exterior del robot es de metal pulido, y la base se ha rediseñado para que quepa debajo de una mesa, siendo más baja, pero más ancha que sus predecesoras. Además, le han añadido detalles como un tirador de cuero para abrir la tapa y espacio para bolsas extra. Como en los sistemas anteriores, iRobot sigue confiando en la bolsa para almacenar la suciedad. De esa manera evita que el polvo se derrame al volcarlo en la basura, ya que la bolsa se cierra nada más sacarla de la base. La bolsa ofrece a la Roomba j7+ una autonomía de más de 60 días. Ahora, hay que tener en cuenta que el precio del dispositivo no está al alcance de todos los bolsillos. El j7+ alcanza los 999 euros, mientras que el j7, a secas, se queda en 749.

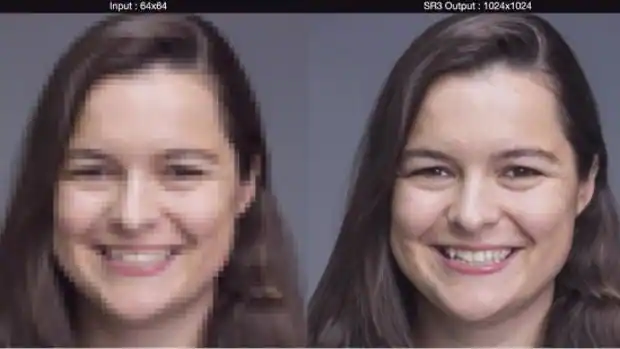

La Inteligencia Artificial lleva años tratando de transformar, de forma radical, la sociedad. Durante los últimos meses, empresas tecnológicas han hecho avances en el campo que permiten, por ejemplo, transcribir la voz sin necesidad de haber entrenado a la máquina con texto o enseñar a un robot a caminar exactamente igual a como lo haría un ser humano. Google, empresa que igual te ayuda a buscar información en Internet que colocarte un altavoz inteligente en la mesilla de noche, no es una excepción. Recientemente, la tecnológica estadounidense ha compartido los resultados de una investigación en la que comparte sus últimos avances para transformar imágenes con una resolución baja en fotografías de gran calidad. «La superresolución tiene muchas aplicaciones que pueden...

La Inteligencia Artificial lleva años tratando de transformar, de forma radical, la sociedad. Durante los últimos meses, empresas tecnológicas han hecho avances en el campo que permiten, por ejemplo, transcribir la voz sin necesidad de haber entrenado a la máquina con texto o enseñar a un robot a caminar exactamente igual a como lo haría un ser humano. Google, empresa que igual te ayuda a buscar información en Internet que colocarte un altavoz inteligente en la mesilla de noche, no es una excepción. Recientemente, la tecnológica estadounidense ha compartido los resultados de una investigación en la que comparte sus últimos avances para transformar imágenes con una resolución baja en fotografías de gran calidad. «La superresolución tiene muchas aplicaciones que pueden...