La amenaza de Pete Hegseth a Dario Amodei tiene un subtexto que va mucho más allá del contrato de 200 millones de dólares que el Pentágono puede cancelar: si el ejército de Estado Unidos despliega armas autónomas controladas por IA sin las salvaguardas que Anthropic exige, habrá eliminado el único cortafuegos que históricamente ha impedido que una orden ilegal se ejecute.

Por qué es importante. Todo el sistema legal y ético de las fuerzas armadas estadounidenses descansa sobre un principio que parece obvio pero que tiene consecuencias importantes: un soldado puede y debe desobedecer una orden manifiestamente ilegal.

Es el mecanismo que, en teoría, impide los crímenes de guerra. Un drone autónomo controlado por IA no tiene ese mecanismo. No puede negarse. No puede dudar. No puede ser juzgado en un consejo de guerra.

Entre líneas. Amodei habla de "armas autónomas que disparan sin intervención humana" para señalar un vacío jurídico. Si una IA toma la decisión de matar, ¿quién responde penalmente? ¿El programador? ¿El general que activó el sistema? ¿El presidente que firmó la orden?

El derecho internacional humanitario (Convenios de Ginebra incluidos) fue redactado pensando en seres humanos que toman decisiones. Y ahora la IA disuelve esa cadena de responsabilidad.

El telón de fondo. El argumento de la vigilancia masiva también es un trago amargo. La Cuarta Enmienda de la Constitución estadounidense protege a los ciudadanos de búsquedas e intervenciones sin orden judicial. Funciona, entre otras razones, porque el Estado nunca ha tenido la capacidad física de procesar todo lo que ocurre en el espacio público.

Y de la misma forma, con la IA ese límite operativo desaparece: pasamos a millones de conversaciones grabadas en tiempo real, transcritas, clasificadas y conectadas en apenas segundos. Lo que antes era imposible por falta de recursos humanos se vuelve rutinario con un LLM. La protección constitucional hasta ahora ha dependido, en parte, de la ineficiencia del Estado, de sus limitaciones.

Sí, pero. El Pentágono tiene un argumento que no es descartable: otras democracias también están desarrollando estas capacidades, y China o Rusia no van a esperar a que Estados Unidos resuelva sus dilemas éticos.

La pregunta práctica es si tener esas capacidades sin restricciones te hace más seguro o simplemente más peligroso para tus propios ciudadanos.

- Amodei lleva meses respondiendo a esa pregunta con una imagen concreta: "un puñado de personas capaces de operar un ejército de drones sin necesitar que ningún otro ser humano coopere".

- Es decir, el riesgo no es solo externo.

La gran pregunta. OpenAI y Google han aceptado las condiciones del Pentágono, "todos los usos legales" sin excepciones específicas, y xAI acaba de recibir autorización para operar en sistemas clasificados. Anthropic se ha quedado sola en su posición.

Y lo que está en juego ahora no es si Claude sobrevive como proveedor militar o no, es si la industria de la IA va a fijar algún límite a lo que vende al Estado, o si ese debate lo zanjará directamente el Congreso, los tribunales o, en el peor de los casos, el primer incidente grave que nadie haya podido prever. Parece cuestión de tiempo.

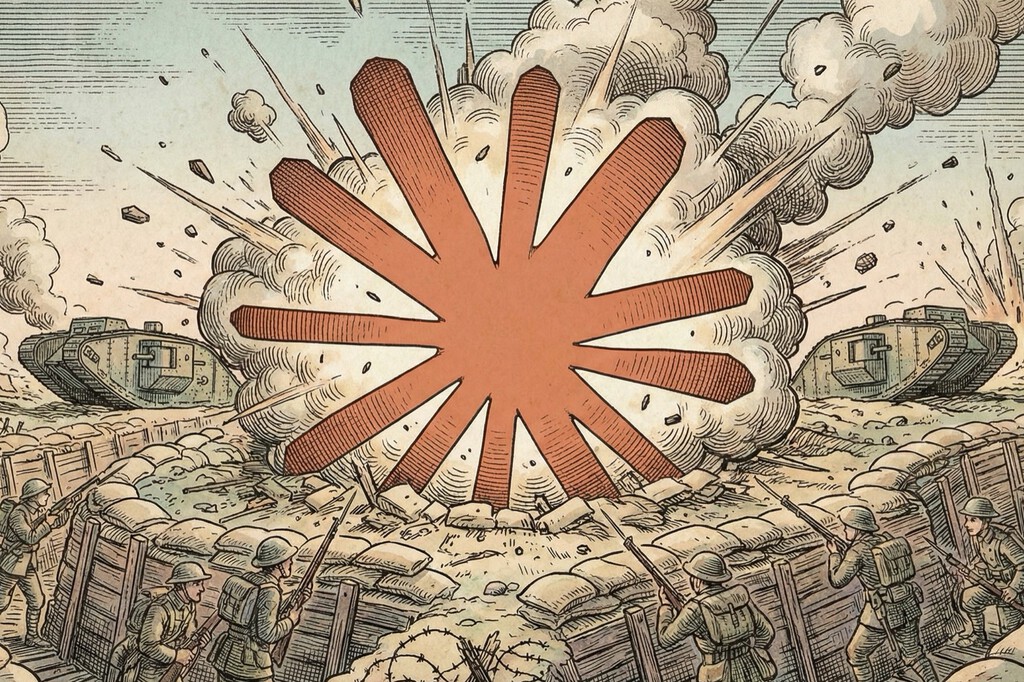

Imagen destacada | Xataka

via Robótica e IA - Xataka https://ift.tt/hZbT1sc

No hay comentarios:

Publicar un comentario