Cuando hablamos de él por primera vez aludimos a su posibilidad de conquistar el mercado masivo, no en vano las 1.000 unidades iniciales que Softbank puso a la venta en Japón se vendieron en apenas un minuto. Pero seis años después la suerte de Pepper, el llamado "robot emocional", parece estar ya en su ocaso, dado que al parecer la producción paró en 2020.

Lo dice Reuters tras haber tenido acceso a documentación relacionada con recortes de personal en el grupo SoftBank y un parón en la producción que también habrían constatado varias fuentes de la publicación. Un indicativo de que el robot fabricado por Foxconn ya no estaría en los planes de las empresas para contratarlo como personal de atención y de que el mítico humanoide estaría ya viviendo su ocaso, de manera discreta y silenciosa.

El ataque de los clones (ayudantes)

Cuando dieron a conocer a Pepper lo que más destacaron de él es su capacidad de analizar los gestos y el tono de voz humanos. Según sus creadores, con el objetivo de "hacer feliz a la gente" y no tanto de servir para las tareas, no en vano tuvieron que establecer una cláusula en sus términos y condiciones para que sus propietarios acepatasen que no lo usarían con fines sexuales. Es buen sabido que para eso hay otro tipo de robots más propicios (con su riesgo mortal y eso), pero para gustos, colores.

El robot ha llegado a ser muy popular, de hecho nos llegó a atender en la feria Viva Technology hace unos años, entre peines y espejos inteligentes, siendo en aquel caso parte del personal de bienvenida y dando indicaciones sobre el evento. SoftBank llegó a asegurar que el robot ayudó a incrementar las ventas hasta en un 70% en programas piloto en California, añadiendo que en ese momento (2017) había unas 10.000 unidades de Pepper en todo el mundo, incluyendo negocios como Pizza Hut (en Singapur) o incluso en hogares particulares de Japón.

¿Qué ha pasado entonces con este robot de faz amistosa y amabilidad robótica innata? Que, según cuentan en Reuters, SoftBank habría cortado el grifo de la producción de este robot ya en 2020, lo cual se habría traducido en una serie de despidos y reubicaciones de empleo (de la división de robótica a otros puestos) al menos en Estados Unidos, Reino Unido, Francia y Japón. De hecho, la propia SoftBank Robotics publicó hace poco que "estaban intentando un plan de optimización a nivel de empleos" derivado de la crisis económica tras la pandemia, pero que seguirían invirtiendo "en las futuras generaciones de robots".

Las fuentes de Reuters hablan de un total de 27.000 unidades producidas, con lo que se habría doblado (y casi triplicado) las que afirmaron haber vendido en 2017, pero aún así han sido demasiado pocas y no se habría asentado como un producto con reclamo, ni mucho menos como nicho de mercado. De ahí que, como parece, los deseos del grupo empresarial de que éste fuese líder en la industria de la robótica, centrándose en el desarrollo de androides asistentes, se habrían diluido.

Al parecer, las funciones limitadas del robot (y ciertas discrepancias culturales entre las divisiones francesa y japonesa, aluden) habrían ocasionado menos ventas de las esperadas. Destacan además que las fuentes apuntan a que reiniciar la producción "sería caro", así que pinta a un final definitivo.

Tras Pepper, en lo sucesivo hemos visto numerosas propuestas de robots asistentes, desde los continuos rumores con Amazon hasta los de Samsung en el último CES, Bot Care y Bot Handy, pasando por el adorable robot de compañía de Panasonic. Parece que el mundo, pese a ya estar acostumbrado a ver robots, no esté preparado para tener aún este nicho de mercado, así que iremos viendo qué pasa con esta rama de negocio en los fabricantes que mantienen su apuesta.

Imagen | Jumpstroy

via Robótica e IA - Xataka https://ift.tt/3jqYLdC

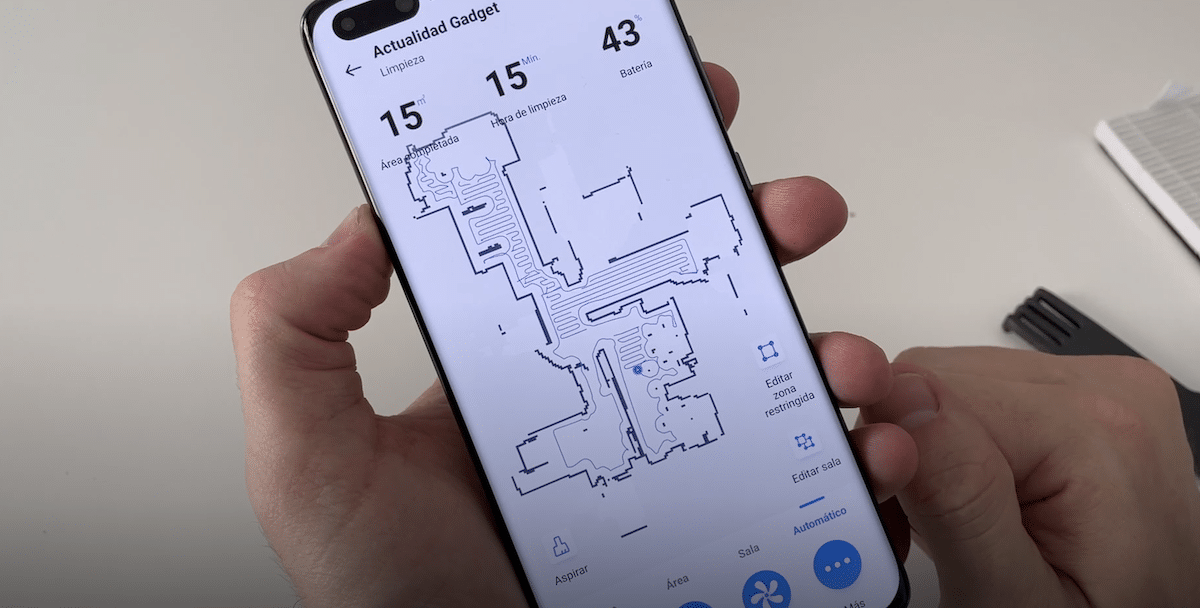

Realme acaba de dar un nuevo paso al frente. Y lo ha hecho lanzando su primer terminal de gama alta, Realme GT, que estará disponible a partir del 21 de este mismo mes de junio. Al mismo tiempo, la firma ha presentado también dos relojes, Watch 2 y Watch 2 Pro, y un nuevo robot aspirador como parte de su nueva plataforma iOT, TechLife. Para el futuro inmediato, aunque no para este lanzamiento, ha anunciado también una tableta y un ordenador portátil. Se trata del primer evento global de una compañía que apenas tiene tres años de vida, pero que ha conseguido ya situarse entre la media docena de mayores fabricantes del mundo. La firma asiática, en efecto, nació en 2018. Y en ese breve tiempo ha conseguido estar presente en 61 mercados, tener 85 millones de usuarios y entrar en el Top 5 de ventas en países tan dispares como Rusia, Grecia, India, Eslovenia o Filipinas. Sus terminales, que combinan las últimas tecnologías con unos precios muy contenidos, han gustado principalmente al público más joven. Y con este nuevo modelo GT la firma logra colocarse en el segmento de la telefonía móvil que le faltaba, el de los topes de gama. Algo que ha conseguido, además, a unos precios muy inferiores de los que su competencia. Realme GT: potencia, rapidez y precio Equipado con una pantalla de 6,43 pulgadas Super Amoled y una resolución FHD+ (2400x1080 píxeles), el nuevo equipo llega con una tasa de refresco de 120Hz y táctil de 360Hz, por lo que la respuesta del panel, tanto a las imágenes de movimiento rápido como al más leve de nuestros toques, será siempre rápida y precisa. El ratio de pantalla es del 91,7%, por lo que los bordes son extremadamente finos. El terminal cuenta con 4.096 niveles de brillo automático, y ajusta en tiempo real la luminosidad de la pantalla para que el visionado sea perfecto en cualquier situación. El lector de huellas está bajo la pantalla. El terminal, cuyo peso es de 186,5 gramos, es también extraordinariamente delgado (73,3 mm) y ello a pesar de ser 5G. El procesador, por su parte, es el más potentes de los de Qualcomm, un Snapdragon 888, el mismo que montan una buena parte de los buques insignia de otras marcas. Entre otras cosas, el procesador es capaz de reducir el consumo de energía del terminal hasta en un 30%, lo que redunda en una mayor duración de la batería. Construido con tecnología de 5 nanómetros, el chip es un 25% más potente y permite hasta un 70% más de rendimiento de la IA que generaciones anteriores. Para acompañar al chip podemos elegir entre versiones con 8 GB o 12 GB de memoria RAM (LPDDR5) y 128 GB ó 256 GB de espacio para almacenamiento. (UFS3.1). Para optimizar al máximo el procesador, los ingenieros de Realme han desarrollado un 'modo GT' que lleva al límite las ya muy altas capacidades del chip. El modo se activa con un simple 'clic' y optimiza la estrategia de trabajo de los varios núcleos para incrementar las prestaciones, algo muy adecuado, por ejemplo, para determinados juegos. La batería, de 4.500 miliamperios, llega acompañada del sistema de carga rápida SuperDart de 65W, lo que significa que puede cargarse de cero a cien en apenas 35 minutos. El cargador, junto a una funda protectora, viene incluido en la caja. Además, una serie de algoritmos de Inteligencia Artificial administran el suministro de energía, "congelando" las aplicaciones abiertas que no estamos usando, colocando automáticamente el terminal en modo de bajo consumo durante la noche o ajustando la frecuencia del procesador según las tareas que estemos realizando en cada momento. Todo lo cual permite que una sola carga supere con creces un día completo de uso. El terminal incluye también la carga reversible, de modo que podremos cargar, con solo apoyarlos sobre la trasera, otros dispositivos como auriculares o relojes inteligentes. En cuanto a las cámaras, que son tres, el nuevo Realme GT está equipado con un sensor principal de 64 megapíxeles (Sony IMX 682), al que acompaña un ultra angular de 8 megapíxeles (y 119 grados de apertura) y una lente macro de 2 megapíxeles y con una función Ultra Macro. La cámara frontal es de 16 megapíxeles. Según Realme, un nuevo algoritmo aplicado al sensor principal consigue una claridad de imagen similar a la de una cámara de 108 megapíxeles. Gracias a la tecnología multi frame, en efecto, la cámara captura varias imágenes a 64 megapíxeles en cada disparo, y las combina en una sola foto en la que se ha reducido el ruido y se ha incrementado la nitidez. El nuevo algoritmo de Realme permite también obtener fotos claras e iluminadas de noche o en ambientes muy oscuros y con poca luz gracias al modo Ultra Nightscape. Algo que también está disponible para la grabación de vídeos. Entre otras funciones, el terminal incorpora AI Passport Photo, que permite hacernos retratos válidos para el DNI o el pasaporte sin necesidad de acudir a un estudio profesional. Por lo que se refiere al sistema operativo, el nuevo Realme GT es de los primeros dispositivos que soporta la versión beta 1 de Android 12, paso previo para la próxima actualización al nuevo sistema operativo de Google. La nueva 'bestia' de Realme llegará a España el próximo 21 de junio. La versión de 8GB + 128GB costará 449 euros, y la de 12GB + 256GB se venderá a 599 euros. Dos relojes y un robot aspirador Se llaman Watch 2 y Watch 2 Pro y cuentan con más de cien esferas diferentes para elegir. El modelo Pro está centrado en el ejercicio y la salud. Cuenta con una pantalla AMOLED de 1,75 pulgadas, con un brillo máximo de 600 nits, mucho más que el anterior modelo de Realme. Cuenta con 90 modos deportivos diferentes, desde maratón a hacer pesas en un gimnasio. Mide la saturación de oxígeno en sangre y cuenta con un GPS integrado. La batería dura hasta 14 días y se carga por completo en dos horas y media. El Watch 2, por su parte, tiene un tamaño más reducido. Los precios son de 54,99 y 74,99 euros, respectivamente. Además del nuevo smartphone y de los smartwatches, Realme presentó su nueva estrategia iOT, TechLife, que será la columna vertebral que permita la interconexión de todos los dispositivos de la marca. A partir de ahora, TechLife será considerada como una marca, y a ella se añadirán toda clase de dispositivos inteligentes. En el futuro, TechLife permitirá añadir tambièn dispositivos de cualquier otra marca. En este contexto, Realme presentó su nuevo robot aspirador, el primer miembro de la nueva familia TechLife. Diseñado desde cero, evita los habituales problemas de conexión que encontramos en otras marcas, y también los molestos 'atascos' y parones que tenemos cada vez que un objeto se cruza con el aspirador en marcha. Su altura es de 10 cm, la cubierta es de cristal templado y llega equipado con toda una serie de nuevas tecnologías, desde el clásico detector de obstáculos a un sensor de paredes, o de vaciado del tanque de agua o, el más importante de todos, un sensor LIDAR que emplea la misma tecnología de navegación que los coches eléctricos y que garantiza movimientos precisos y en tiempo real, generando mapas exactos de cada habitación. Todo se puede controlar a través de una 'app' instalada en el móvil. El precio es de 299 euros.

Realme acaba de dar un nuevo paso al frente. Y lo ha hecho lanzando su primer terminal de gama alta, Realme GT, que estará disponible a partir del 21 de este mismo mes de junio. Al mismo tiempo, la firma ha presentado también dos relojes, Watch 2 y Watch 2 Pro, y un nuevo robot aspirador como parte de su nueva plataforma iOT, TechLife. Para el futuro inmediato, aunque no para este lanzamiento, ha anunciado también una tableta y un ordenador portátil. Se trata del primer evento global de una compañía que apenas tiene tres años de vida, pero que ha conseguido ya situarse entre la media docena de mayores fabricantes del mundo. La firma asiática, en efecto, nació en 2018. Y en ese breve tiempo ha conseguido estar presente en 61 mercados, tener 85 millones de usuarios y entrar en el Top 5 de ventas en países tan dispares como Rusia, Grecia, India, Eslovenia o Filipinas. Sus terminales, que combinan las últimas tecnologías con unos precios muy contenidos, han gustado principalmente al público más joven. Y con este nuevo modelo GT la firma logra colocarse en el segmento de la telefonía móvil que le faltaba, el de los topes de gama. Algo que ha conseguido, además, a unos precios muy inferiores de los que su competencia. Realme GT: potencia, rapidez y precio Equipado con una pantalla de 6,43 pulgadas Super Amoled y una resolución FHD+ (2400x1080 píxeles), el nuevo equipo llega con una tasa de refresco de 120Hz y táctil de 360Hz, por lo que la respuesta del panel, tanto a las imágenes de movimiento rápido como al más leve de nuestros toques, será siempre rápida y precisa. El ratio de pantalla es del 91,7%, por lo que los bordes son extremadamente finos. El terminal cuenta con 4.096 niveles de brillo automático, y ajusta en tiempo real la luminosidad de la pantalla para que el visionado sea perfecto en cualquier situación. El lector de huellas está bajo la pantalla. El terminal, cuyo peso es de 186,5 gramos, es también extraordinariamente delgado (73,3 mm) y ello a pesar de ser 5G. El procesador, por su parte, es el más potentes de los de Qualcomm, un Snapdragon 888, el mismo que montan una buena parte de los buques insignia de otras marcas. Entre otras cosas, el procesador es capaz de reducir el consumo de energía del terminal hasta en un 30%, lo que redunda en una mayor duración de la batería. Construido con tecnología de 5 nanómetros, el chip es un 25% más potente y permite hasta un 70% más de rendimiento de la IA que generaciones anteriores. Para acompañar al chip podemos elegir entre versiones con 8 GB o 12 GB de memoria RAM (LPDDR5) y 128 GB ó 256 GB de espacio para almacenamiento. (UFS3.1). Para optimizar al máximo el procesador, los ingenieros de Realme han desarrollado un 'modo GT' que lleva al límite las ya muy altas capacidades del chip. El modo se activa con un simple 'clic' y optimiza la estrategia de trabajo de los varios núcleos para incrementar las prestaciones, algo muy adecuado, por ejemplo, para determinados juegos. La batería, de 4.500 miliamperios, llega acompañada del sistema de carga rápida SuperDart de 65W, lo que significa que puede cargarse de cero a cien en apenas 35 minutos. El cargador, junto a una funda protectora, viene incluido en la caja. Además, una serie de algoritmos de Inteligencia Artificial administran el suministro de energía, "congelando" las aplicaciones abiertas que no estamos usando, colocando automáticamente el terminal en modo de bajo consumo durante la noche o ajustando la frecuencia del procesador según las tareas que estemos realizando en cada momento. Todo lo cual permite que una sola carga supere con creces un día completo de uso. El terminal incluye también la carga reversible, de modo que podremos cargar, con solo apoyarlos sobre la trasera, otros dispositivos como auriculares o relojes inteligentes. En cuanto a las cámaras, que son tres, el nuevo Realme GT está equipado con un sensor principal de 64 megapíxeles (Sony IMX 682), al que acompaña un ultra angular de 8 megapíxeles (y 119 grados de apertura) y una lente macro de 2 megapíxeles y con una función Ultra Macro. La cámara frontal es de 16 megapíxeles. Según Realme, un nuevo algoritmo aplicado al sensor principal consigue una claridad de imagen similar a la de una cámara de 108 megapíxeles. Gracias a la tecnología multi frame, en efecto, la cámara captura varias imágenes a 64 megapíxeles en cada disparo, y las combina en una sola foto en la que se ha reducido el ruido y se ha incrementado la nitidez. El nuevo algoritmo de Realme permite también obtener fotos claras e iluminadas de noche o en ambientes muy oscuros y con poca luz gracias al modo Ultra Nightscape. Algo que también está disponible para la grabación de vídeos. Entre otras funciones, el terminal incorpora AI Passport Photo, que permite hacernos retratos válidos para el DNI o el pasaporte sin necesidad de acudir a un estudio profesional. Por lo que se refiere al sistema operativo, el nuevo Realme GT es de los primeros dispositivos que soporta la versión beta 1 de Android 12, paso previo para la próxima actualización al nuevo sistema operativo de Google. La nueva 'bestia' de Realme llegará a España el próximo 21 de junio. La versión de 8GB + 128GB costará 449 euros, y la de 12GB + 256GB se venderá a 599 euros. Dos relojes y un robot aspirador Se llaman Watch 2 y Watch 2 Pro y cuentan con más de cien esferas diferentes para elegir. El modelo Pro está centrado en el ejercicio y la salud. Cuenta con una pantalla AMOLED de 1,75 pulgadas, con un brillo máximo de 600 nits, mucho más que el anterior modelo de Realme. Cuenta con 90 modos deportivos diferentes, desde maratón a hacer pesas en un gimnasio. Mide la saturación de oxígeno en sangre y cuenta con un GPS integrado. La batería dura hasta 14 días y se carga por completo en dos horas y media. El Watch 2, por su parte, tiene un tamaño más reducido. Los precios son de 54,99 y 74,99 euros, respectivamente. Además del nuevo smartphone y de los smartwatches, Realme presentó su nueva estrategia iOT, TechLife, que será la columna vertebral que permita la interconexión de todos los dispositivos de la marca. A partir de ahora, TechLife será considerada como una marca, y a ella se añadirán toda clase de dispositivos inteligentes. En el futuro, TechLife permitirá añadir tambièn dispositivos de cualquier otra marca. En este contexto, Realme presentó su nuevo robot aspirador, el primer miembro de la nueva familia TechLife. Diseñado desde cero, evita los habituales problemas de conexión que encontramos en otras marcas, y también los molestos 'atascos' y parones que tenemos cada vez que un objeto se cruza con el aspirador en marcha. Su altura es de 10 cm, la cubierta es de cristal templado y llega equipado con toda una serie de nuevas tecnologías, desde el clásico detector de obstáculos a un sensor de paredes, o de vaciado del tanque de agua o, el más importante de todos, un sensor LIDAR que emplea la misma tecnología de navegación que los coches eléctricos y que garantiza movimientos precisos y en tiempo real, generando mapas exactos de cada habitación. Todo se puede controlar a través de una 'app' instalada en el móvil. El precio es de 299 euros.